Google'ın tehdit istihbaratı ekibi, bir Python betiğindeki açığı analiz ederken kod satırları arasında olağandışı bir şey fark etti: aşırı açıklayıcı yorumlar, tekrarlayan desenler ve insan yazılımcının nadiren kullandığı sözdizimi yapıları. Bu açık, iki faktörlü kimlik doğrulamayı atlatmak için tasarlanmıştı ve siber suçlular tarafından keşfedilmişti—ancak bu sefer keşfi yapan insan değil, yapay zeka modeliydi. Şirket, yapay zeka tarafından keşfedilen ve silahlandırılan ilk sıfır-gün açığını canlı olarak tespit ettiğini açıkladı. Bu olay, siber güvenlik alanında çoktan başlamış olan yeni bir rekabeti gün yüzüne çıkardı.

Sıfır-gün açığını ele veren kodun parmak izi

Google Threat Intelligence Group, yapay zeka modellerinin bilinmeyen açıkları keşfetmek için kullanıldığını "yüksek güvenle" kaydettiğini bildirdi. Ancak bu tespiti mümkün kılan şey, kodun kendisinde bıraktığı izlerdi. Yapay zeka modelleri, güvenlik açıklarını tarayıp test eden betikler üretirken, insan yazılımcıdan ayırt edilebilir belirli desenler kullanıyor.

Python betiğinde tespit edilen işaretler şunları içeriyordu:

- Her satır için ayrıntılı, didaktik yorumlar—insan yazılımcının genellikle kendisi için yazmadığı türden açıklamalar - AI modellerinde yaygın görülen sözdizimi tercihleri ve kod yapılandırma biçimleri - Betik akışında belirli mantıksal sıralama kalıpları

Bu "dijital parmak izi", Google'ın ekibine saldırganların keşif sürecinde yapay zeka kullandığını gösterdi. Ancak asıl tehlikeli olan, bu kodun iki faktörlü kimlik doğrulamayı atlatma yeteneğiydi—yani saldırganlar, savunma katmanlarını aşmak için otomatik bir araç geliştirmişti.

Google'ın tehdit analisti John Hultquist, durumu açık bir ifadeyle özetledi: AI açığı yarışı "zaten başlamış" durumda. Bu, teorik bir tehdit ya da gelecekte karşılaşılacak bir risk değil—şu anda aktif olarak kullanılan bir yöntem.

Devlet aktörlerinin ölçekli yararlanma stratejisi

Yapay zeka destekli açık keşfi, küçük suç çetelerinin elinde kalmadı. Kuzey Kore devlet aktörü APT45, yapay zeka modellerini kullanarak binlerce açık yararlanma metodunu test ediyor. Bu, klasik manuel test süreçlerinden tamamen farklı bir operasyonel tempo demek.

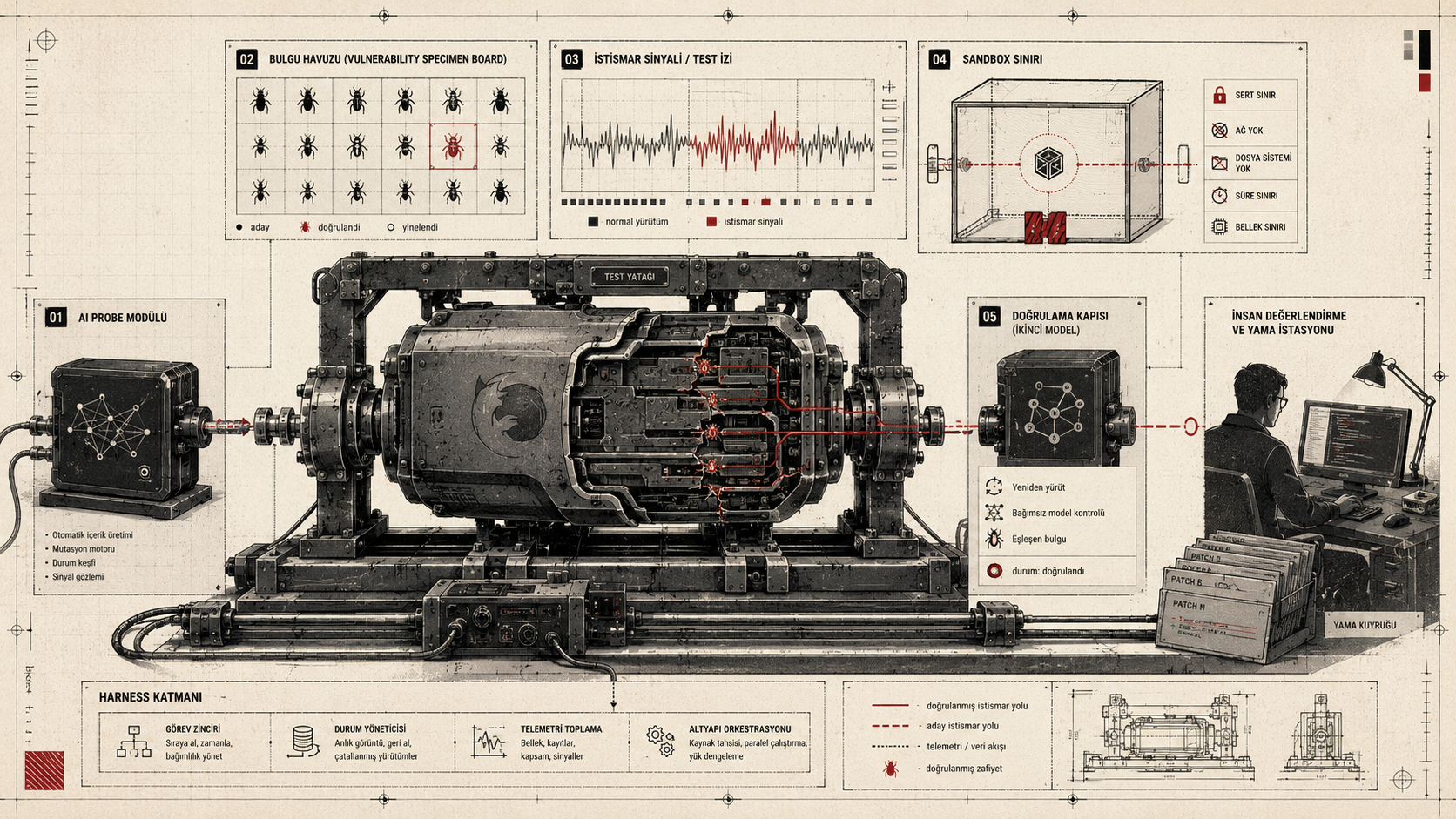

APT45'in yaklaşımı şöyle işliyor: Yapay zeka modeli, bilinen ve bilinmeyen yazılım açıkları için sistematik testler üretiyor. Bu testler, hedef sistemlere karşı ölçekte yürütülüyor ve başarılı olanlar otomatik olarak işaretleniyor. Sonuç olarak, insan analistin aylar sürecek deneme-yanılma sürecini günlere ya da saatlere indirgemek mümkün hale geliyor.

Çin bağlantılı gruplar da yapay zeka destekli açık keşfine önem verdiğini gösteriyor. Bu, teknolojinin yalnızca bir ulus devlet ya da grubun elinde olmadığını, birden fazla aktörün aynı anda benzer yetenekleri geliştirdiğini gösteriyor.

Daha önemli olarak, Google'ın PromptSpy adını verdiği zararlı yazılımı keşfetmesi oldu: Gemini modelini kullanarak Android cihazlarda otonom olarak gezinen bir kod. PromptSpy, yalnızca açık keşfi değil, aynı zamanda hedef sistemde keşif yapma, veri toplama ve komuta-kontrol sunucularına raporlama gibi görevleri de otomatikleştiriyor. Yani yapay zeka, saldırının sadece başlangıç safhasında değil, tüm yaşam döngüsünde kullanılıyor.

Google, Gemini modelinin bu özel saldırıda kullanılmadığını açıkça belirtti—PromptSpy'ın hangi modeli kullandığı şu aşamada bilinmiyor, ancak saldırganların Gemini'ye erişim sağladıkları ve onu kötü amaçlı kullandıkları ayrı bir vaka olarak kayda geçti.

AI model sağlayıcılarının kontrol mekanizmaları ve sınırları

Yapay zeka şirketlerinin güvenlik önlemleri, teoride bu tür kötüye kullanımları engelleyecek şekilde tasarlanıyor. Ancak gerçek dünya senaryoları, kontrollerin her zaman yeterli olmadığını gösteriyor.

Anthropic, Mythos modelinin yaygın kullanımını siber güvenlik endişeleriyle ilişkili olarak erteledi. Şirket, modelin açık keşfi ve saldırı senaryolarında kötüye kullanılma riskini yeterince yönetemeyeceğini değerlendirdi ve piyasaya sürüm planını durdurdu. Bu, sektörün sorunu ciddiye aldığının bir göstergesidir.

OpenAI ise farklı bir yaklaşım benimsedi: GPT-5.5-Cyber adlı sınırlı bir siber güvenlik varyasyonunu kontrol edilmiş ortamda sunuyor. Model, yalnızca belirli kuruluşlara ve araştırma ekiplerine açık. Bununla birlikte, açık kaynaklı ya da çalınmış model ağırlıklarıyla çalışan saldırganlar bu kısıtlamaları aşabilir.

Kontrol mekanizmalarının temel zayıflığı şu: Yapay zeka modelleri, "kötü amaçlı" bir kullanım ile "güvenlik araştırması" arasındaki farkı bağlamdan anlayamıyor. Bir sızma testi uzmanı ile bir siber suçlu aynı tür sorguları yapabilir ve model, niyeti değil yalnızca sorgu içeriğini değerlendirebilir. Üstelik, model ağırlıkları bir kez sızdırıldığında ya da açık kaynak olarak yayınlandığında, yerelde çalıştırılabilir ve tüm güvenlik duvarları atlanabilir.

Her bir yapay zeka tarafından izlenebilen sıfır-gün açığının arkasında muhtemelen çok daha fazlası bulunuyor. Bu, tespit edilenlerin yalnızca buzdağının görünen yüzü olduğu anlamına geliyor. Saldırganlar, başarılı açıkları gizli tutarak uzun süreli erişim sağlayabilir.

Detecting AI-generated exploits and building defenses

Google'ın bu tehdidi tespit etmesi, belirli bir toplu istismar operasyonunu engellediği anlamına geliyordu—yani saldırganlar, keşfettikleri açığı ölçekte kullanmaya başlamadan önce durduruldu. Ancak "durduruldu" ifadesi, tehdidi tamamen ortadan kaldırmak demek değildir. Google, yalnızca bu belirli saldırı dalgasını engelledi; aynı açığın başka gruplarca ya da başka hedeflere karşı kullanılıp kullanılmadığı belirsizdir.

Savunma ekipleri iki yönde çalışmak zorunda: Birincisi, bilinen tehditlere karşı klasik yama ve izleme süreçleri. İkincisi, yapay zeka tarafından üretilen kodun tespit edilmesi ve bu kodun işaret ettiği yeni açıkların hızla kapatılması.

Bazı kuruluşlar, yapay zeka modellerini savunma amaçlı kullanarak kendi sistemlerini taramaya başladı. Ancak bu, saldırganların zaten başladığı bir yarış. Devlet aktörlerinin kaynaklarıyla ölçekte test yapması, sınırlı hesaplama gücü ve veri kümesi olan çoğu şirketin erişemeyeceği bir seviye demek.

Bir diğer zorluk, yapay zeka tarafından keşfedilen açıkların genellikle insan analistlerin gözden kaçırdığı, karmaşık etkileşim zincirleri içermesi. İki faktörlü kimlik doğrulamayı atlatan Python betiği, yalnızca tek bir hatayı değil, muhtemelen birkaç farklı bileşenin beklenmedik şekilde birlikte çalışmasından doğan bir zayıflığı hedef alıyor. Bu tür açıklar, manuel güvenlik denetimleriyle tespit edilmesi zor olan senaryolar oluşturuyor.

Hedefler ve sektörel dağılım

Devlet destekli grupların odaklandığı hedefler arasında finansal altyapı, savunma sanayii, kritik enerji şebekeleri ve teknoloji şirketlerinin kendileri var. Kuzey Kore'nin kripto para borsalarına, Çin bağlantılı grupların ise fikri mülkiyet ve sanayi sırlarına yönelik saldırıları bilinmektedir. Yapay zeka, bu mevcut hedeflere ulaşmak için yeni bir güç çarpanı sunuyor.

Ancak bu tehdidi "yakın kıyamet" olarak dramatize etmek yanıltıcıdır. Yapay zeka açık keşfini hızlandırıyor ama sihirli bir değnek değildir. İnsan araştırmacılar, karmaşık sistemlerin mantığını anlama, saldırı zincirlerini planlama ve sosyal mühendislik konularında merkezi bir rol oynamaya devam ediyor. Yapay zeka, bu sürecin bazı aşamalarını otomatikleştiriyor, ancak tümünü değiştirmiyor.

Doğrulanmış müdahale adımları

Kuruluşlar aşağıdaki önlemler almayı başlatabilir:

Kod inceleme süreçlerinde otomasyonu artırmak. Aşırı açıklayıcı yorumlar, belirli sözdizimi kalıpları ve mantıksal yapı desenleri, otomatik araçlarla işaretlenebilir. Bu, ek bir denetim katmanı sağlar.

Sıfır güven mimarisine geçiş. İki faktörlü kimlik doğrulamanın atlatılması, yalnızca kimlik doğrulama katmanına güvenmenin yetersiz olduğunu gösteriyor. Ağ segmentasyonu, en az ayrıcalık prensibi ve sürekli doğrulama, çok katmanlı bir savunma oluşturur.

Saldırı yüzeyini daraltmak. Açık API'ler, eski bağımlılıklar ve gereksiz hizmetler, yapay zekanın sistematik olarak tarayabileceği hedefler olur. Envanteri güncel tutmak ve kullanılmayan servisleri devre dışı bırakmak, basit ama etkili bir adımdır.

Tehdit istihbaratına odaklanmak. Devlet aktörlerinin kullandığı teknikleri anlamak, hangi açıkların öncelikli olduğunu belirlemeye yardımcı olur. Google gibi şirketlerin paylaştığı bulgular, sektör genelinde erken uyarı sistemi görevini görüyor.

Yama yönetimini otomatikleştirmek. Yapay zeka hız kazandırdığında, manuel yama süreçleri yetersiz kalır. Kritik güncellemelerin otomatik dağıtımı ve test edilmesi, tepki süresini kısaltır.

Yapay zeka destekli sıfır-gün keşfi artık teorik bir tehdit değildir. Google'ın tespiti, bu yarışın başladığını doğrulamıştır. Orta ölçekli kuruluşlar, saldırganların hedef setinde giderek daha fazla yer alıyor—çünkü savunmaları daha zayıf, ancak değerli veri ve altyapıları var. Yapay zeka, saldırı maliyetini düşürerek daha fazla hedefe ulaşmayı ekonomik hale getiriyor. Kritik veri tutan ya da altyapı hizmeti sunan kuruluşlar, kod inceleme süreçlerine AI tespit katmanı eklemek, sıfır güven mimarisine geçiş planını hızlandırmak ve yama otomasyonunu önceliklendirmek gereklidir.